Nvidia anticipează comenzi de 1 trilion de dolari pentru noile cipuri AI

Directorul general al Nvidia, Jensen Huang, a anunțat luni, în cadrul conferinței anuale pentru dezvoltatori GTC 2026, că estimează comenzi de aproximativ 1 trilion de dolari pentru sistemele sale Blackwell și Vera Rubin. Aceste sisteme reprezintă noile generații de platforme hardware pentru inteligența artificială (AI), dezvoltate de Nvidia, și se bazează pe procesoare grafice și sisteme de calcul proiectate pentru centrele de date. Ele vor fi utilizate pentru antrenarea și rularea modelelor avansate de AI.

Huang a explicat că cererea provine atât din partea startup-urilor, cât și a companiilor mari care dezvoltă aplicații AI. Nevoia de putere de calcul crește rapid, mai ales odată cu apariția „agentic AI”, adică a aplicațiilor capabile să creeze alți agenți software pentru a îndeplini sarcini complexe.

Creșterea estimărilor companiei a determinat o creștere a acțiunilor Nvidia cu aproximativ 2% luni. Nvidia este în prezent cea mai valoroasă companie listată la bursă din lume, cu o capitalizare de piață de aproximativ 4,5 trilioane de dolari, un indicator al importanței sale în dezvoltarea AI. Compania a raportat deja 11 trimestre consecutive cu creșteri ale veniturilor de peste 55% și a anunțat că veniturile pentru trimestrul curent ar putea crește cu aproximativ 77% față de anul precedent, până la circa 78 de miliarde de dolari.

Platformele Vera Rubin și impactul lor în centrele de date

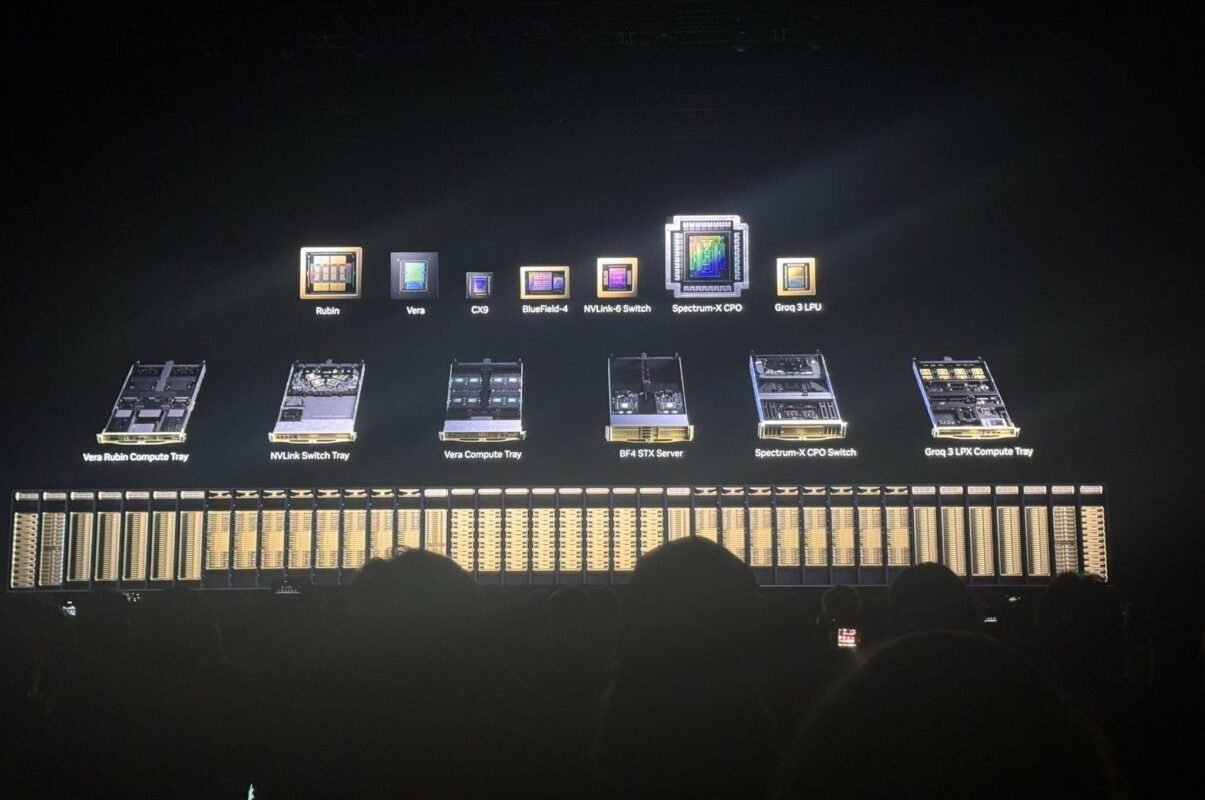

Noua platformă Vera Rubin, care va fi lansată mai târziu în acest an, promite să ofere de până la zece ori mai multă performanță per watt decât sistemul anterior Grace Blackwell. Eficiența energetică a devenit un factor crucial, pe măsură ce centrele de date dedicate AI consumă tot mai multă energie.

În cadrul conferinței, Huang a prezentat și Groq 3 Language Processing Unit (LPU), o unitate de procesare a limbajului dezvoltată de startup-ul Groq. Nvidia a preluat în mare parte această companie printr-o tranzacție de aproximativ 20 de miliarde de dolari în decembrie. Cipul este proiectat pentru a accelera procesarea modelelor de limbaj și pentru a funcționa alături de GPU-urile Nvidia, oferind performanțe superioare.

Nvidia a prezentat, de asemenea, un rack dedicat acceleratoarelor Groq, o structură de tip server utilizată în centrele de date. Sistemul va integra 256 de unități LPU și va putea funcționa împreună cu platformele Vera Rubin. Potrivit companiei, această configurație ar putea crește de până la 35 de ori performanța generării de „tokeni per watt” a GPU-urilor Rubin – un indicator al eficienței sistemului.

Arhitectura viitoarelor sisteme AI, Kyber

Jensen Huang a prezentat un prototip al viitoarei arhitecturi de rack Kyber, un sistem de servere pentru centre de date. Aceasta va integra 144 de GPU-uri montate vertical, pentru a crește densitatea și a reduce latența. Designul este programat să fie integrat în sistemul Vera Rubin Ultra, cu lansare estimată în 2027.

Aceste evoluții vin într-un moment în care industria de AI continuă să crească rapid, cu o cerere tot mai mare de hardware performant și eficient energetic. Anticipațiile Nvidia privind comenzile de un triliion de dolari evidențiază amploarea acestei piețe în expansiune.

Sursa: Mediafax

Fii primul care comentează