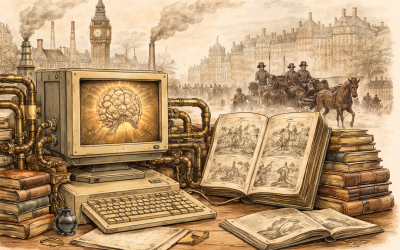

O nouă perspectivă în inteligența artificială: modele care „gândesc” prin mai multe voci interne

Discuțiile despre capacitatea modelelor de inteligență artificială de a „gândi” au evoluat considerabil în ultimul an. Dacă inițial întrebarea era dacă acestea pot avea lanțuri mai lungi de raționament, acum se indreaptă spre deducția mai profundiă: cum se organizează, de fapt, pașii internați care conduc la un răspuns coerent și relevant. O cercetare recentă a evidențiat că un salt important în performanță nu provine doar din creșterea puterii de calcul, ci și din modul în care aceste modele „gândește” în interior, asemănător cu o dezbatere internă.

Diversitatea interne ca motor al performanței

Studiul, realizat pe baza analizelor modelelor chinezești DeepSeek R1 și QwQ-32B al Alibaba Cloud, arată că aceste sisteme nu se limitează la o singură cale de raționament. În „urmele” lor de gândire, cercetătorii au identificat figuri de stil diferite, cu perspective în conflict, care se corectează și se recunosc reciproc, asemenea unui grup de oameni care discută și ajung împreună la o concluzie. Pe scurt, nu este vorba doar despre „mai mult timp de gândire”, ci despre mai multe voci interne care socializează și se confruntă, pentru a ajunge la soluția optimă.

Această idee de „societies of thought” – societăți de gândire – se sprijină pe o analogie cu inteligența colectivă umană. În contexte umane, diversitatea de opinii și explicațiile reciproce conduc deseori la decizii mai bune. În cazul modelelor AI, autoriile studiului susțin că și acestea, în interiorul lor „simulează” o astfel de dinamica, exprimând diferite ipoteze și verificându-le între ele înainte de a finaliza răspunsul.

Asta înseamnă că modelele nu livrează o singură pistă de răspuns, ci „joacă” mai multe roluri cognitive, testând, comparând și corectând. Astfel, ele devin mai robuste, mai capabile să depășească potențialele erori și ambiguități.

Implicații pentru dezvoltarea viitoare a IA

Pentru industria tehnologică, această descoperire are implicații majore. În loc să ne concentrăm exclusiv pe creșterea dimensiunii modelelor, developerii pot pune accent pe modul în care acestea explorează soluțiile. Mai precis, se pune accent pe structurerile care încurajează diversitatea de perspective și micro-dezbaterile interne, chiar și în faza de antrenare. Aceasta poate însemna recompense mai clare pentru claritate, autocorecție și confruntare constructivă între ipoteze.

Cercetarea aduce în discuție și modelele chinezești precum QwQ-32B și DeepSeek R1, nu doar ca exemplu de inovație tehnologică, ci și ca semnale ale unei curse globale în AI, unde modele compacte, eficiente și integrative devin din ce în ce mai importante. Alibaba a promovat modelul QwQ-32B ca un contrast la gigantii americani, demonstrând că performanța nu se măsoară exclusiv în parametri. În același timp, prezența acestor modele în atenția cercetătorilor internaționali evidențiază potențialul lor pentru competiția globală, mai ales dacă sunt accesibile și deschise pentru teste interdisciplinare.

Pentru utilizatorii obișnuiți, aceste descoperiri au un sens practic direct. În procesul de utilizare, răspunsurile nu trebuie privite ca adevăruri absolute, ci ca rezultatele unui dialog intern complex, în care întrebările și verificările repetitive pot stimula performanța. În plus, dacă se folosesc modele open-weight sau servicii terțe, este esențială o atentă verificare a datelor și a politicilor de confidențialitate, pentru a exploata beneficiile acestor tehnologii într-un mod responsabil.

Pe măsură ce aceste cercetări se aprofundeză și modelele devin tot mai sofisticate, devine clar că nu doar mărimea contează în evoluția inteligenței artificiale, ci și modul în care acestea „gândesc”. Un sistem capabil să aibă discuții interne și să se auto-analizeze poate însemna o abordare mai sigură și mai adaptabilă, pe termen lung. În acest context, explorarea și înțelegerea mecanismelor interne ale AI devine nu doar un interes academic, ci și o prioritate pentru dezvoltarea unor modele mai inteligente și mai responsabile.

Fii primul care comentează