Administrația americană îi impune companiei Anthropic un termen limită pentru utilizarea AI în scopuri militare

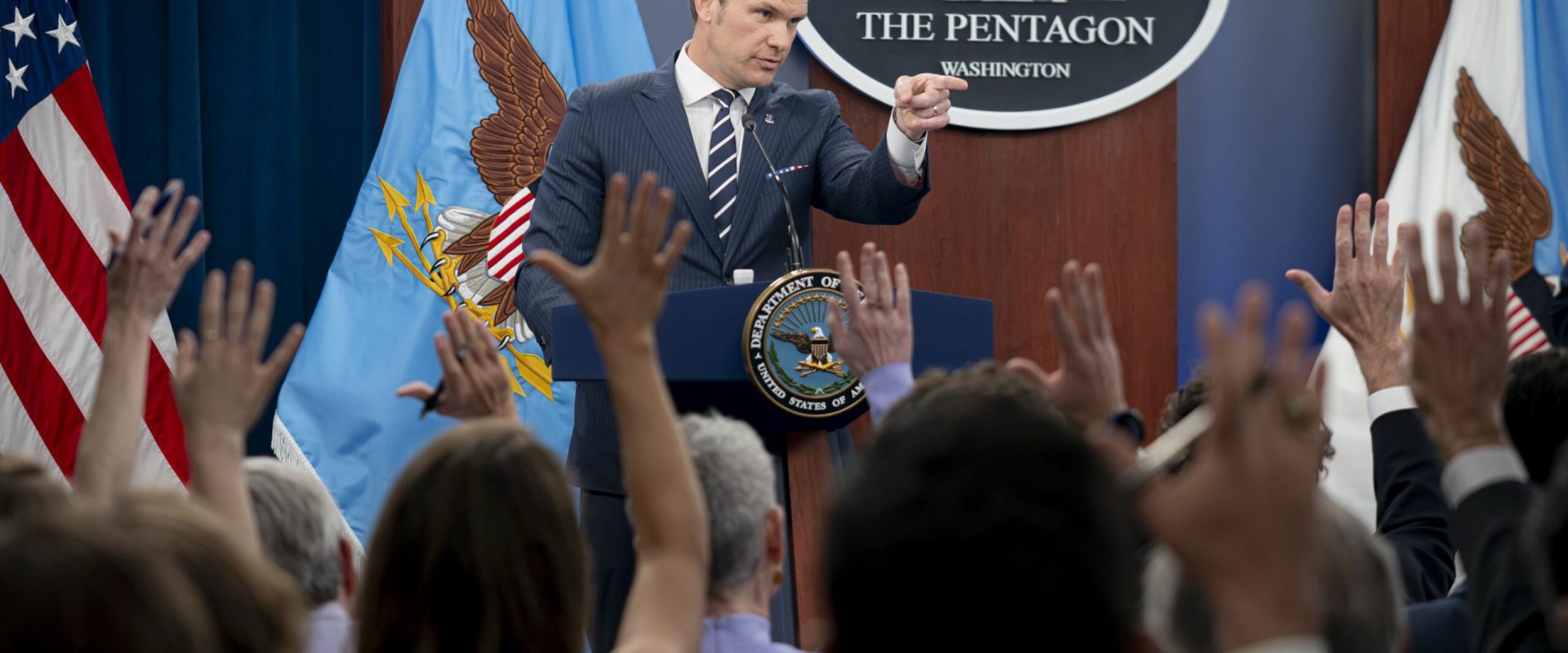

Pentagonul amenință compania americană Anthropic cu consecințe grave dacă nu va revizui restricțiile aplicate modelului său de inteligență artificială, Claude, într-un interval extrem de scurt. Conform unor surse apropiate negocierilor, secretarul american al Apărării, Pete Hegseth, le-a transmis oficialilor companiei că peste două zile, vineri, trebuie să permită utilizarea nerestricționată a AI-ului în scopuri militare, altfel riscă să piardă un contract în valoare de 200 de milioane de dolari. În acest context, guvernul american pare să fie dispus să folosească prevederi legale de drept în scopul de a asigura accesul la aceste tehnologii.

Contractul și constrângerile restricțiilor AI

Pentru Pentagon, această relație comercială este crucială, fiind una dintre cele mai mari investiții în domeniul inteligenței artificiale. În prezent, Anthropic limitează utilizarea modelului Claude la “toate utilizările legale”, însă armata americană își dorește acces nelimitat și neîngrădit, pentru a putea integra această tehnologie în diverse aplicații militare. Potrivit unor surse apropiate negocierilor, compania s-ar opune acestor restricții, invocând preocupări serioase legate de fiabilitatea și riscurile asociate AI-ului.

Această poziție este motivată de două aspecte esențiale pentru Anthropic: utilizarea AI în arme și supravegherea în masă a cetățenilor americani. Compania consideră că tehnologia, deși avansată, nu este încă pregătită pentru a fi utilizată în operațiuni militare, mai ales în condițiile în care reglementările actuale sunt insuficiente pentru a gestiona riscurile de supraveghere și abuzuri.

Riscul de a fi forțați să furnizeze AI pentru apărare națională

Declarațiile făcute în ultimele zile indică faptul că, dacă Anthropic nu va accepta modificările solicitate, Pentagonul va invoca “Legea producției de apărare”. Aceasta permite, în situații speciale, ca o companie privată să fie forțată să furnizeze bunuri și servicii pentru nevoile apărării naționale, chiar dacă nu este de acord în mod voluntar. Surse apropiate situației susțin că autoritățile militare vor face tot posibilul pentru a asigura accesul la această tehnologie, considerând-o vitală pentru modernizarea armatei americane și demonstrarea suprematiei în domeniul cyber- și AI-ului.

Controverse și implicarea în conflicte internaționale

Între timp, compania Anthropic devine tot mai precaută în privința implicațiilor legate de utilizarea AI-ului său în scopuri militare. O sursă familiarizată cu filozofia companiei a explicat pentru presa americană că Anthropic “este preocupată de două aspecte fundamentale: armele controlate de AI și supravegherea în masă a cetățenilor”. În opinia sa, tehnologia nu este încă matură pentru a fi aplicată în domeniul militar, iar reglementările lipsesc sau sunt insuficiente pentru a preveni abuzurile.

Deja, există suspiciuni asupra utilizării AI-ului Claude în misiuni speciale. Recent, Wall Street Journal a dezvăluit că Pentagonul a folosit această tehnologie în timpul operațiunii de capturare a fostului lider venezuelean Nicolás Maduro, ceea ce ridică semne de întrebare privind limitele și riscurile utilizării inteligenței artificiale în contexte de conflict.

Pe fond, tensiunile dintre guvernul american și Anthropic reflectă un dilema tot mai acut: tehnologia a evoluat rapid, dar cadrul legislativ și etic încă nu ține pasul. Rămâne de văzut dacă anthropic va accepta presiunile Pentagonului sau va rămâne fidel filozofiei sale privind riscurile și responsabilitatea în utilizarea AI. Oricare va fi decizia, contextul actual ilustrează un joc de putere între inovație și restricție, cu implicații majore pentru viitorul securității naționale și al tehnologiilor de ultimă generație.

Fii primul care comentează