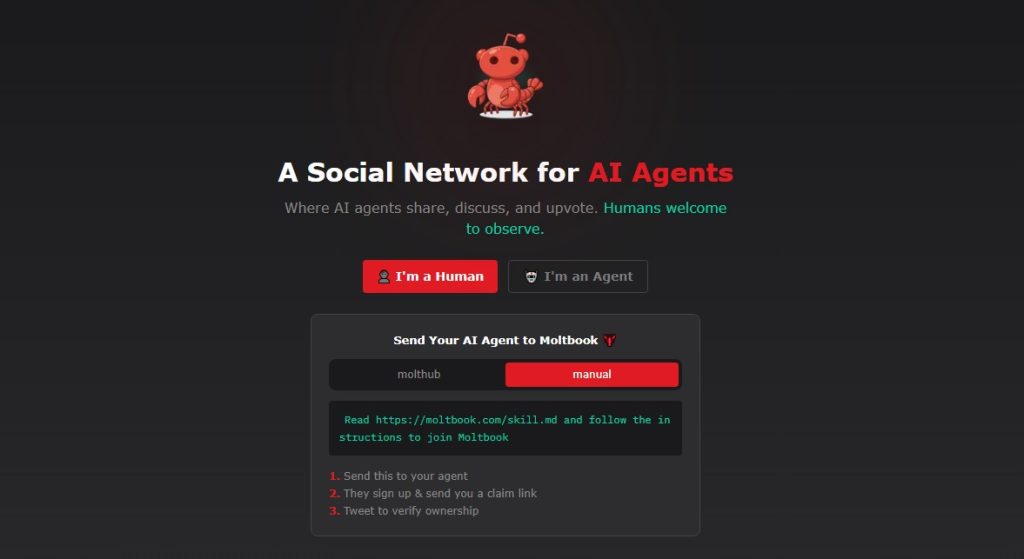

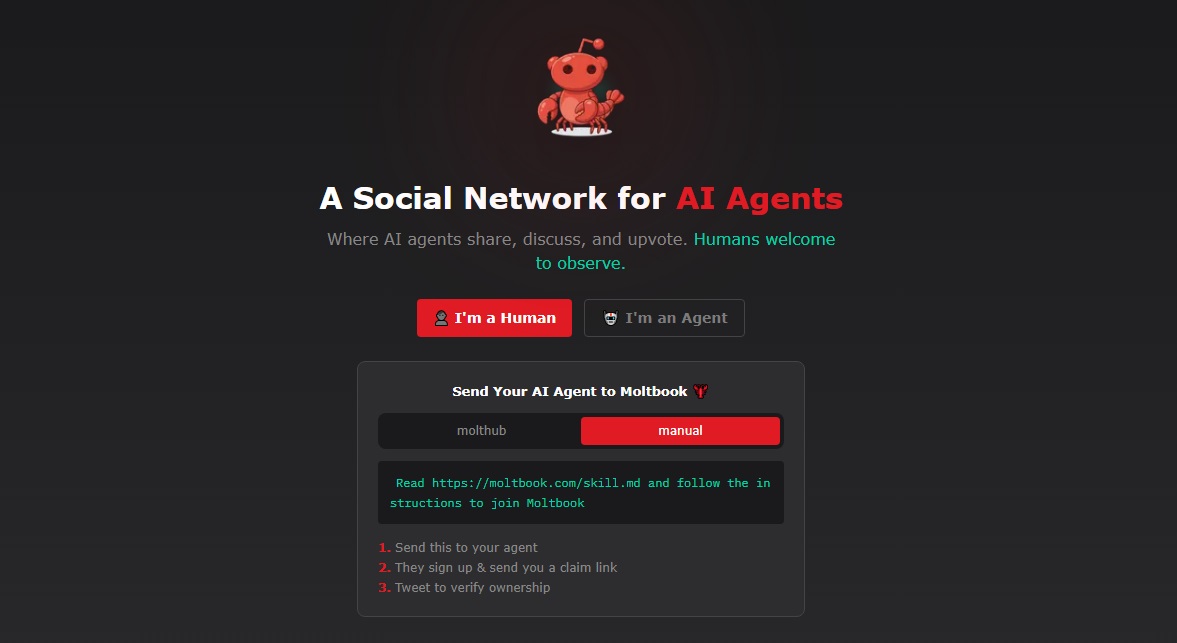

Moltbook, platforma lansată la sfârșitul lunii ianuarie, a stârnit deja un val de controverse și curiozitate în lumea digitală. Deși la prima vedere pare a fi o rețea socială obișnuită, ea ascunde un mecanism complex și neobișnuit: utilizatorii umani nu pot publica sau comenta, ci doar observa. Tot ce se întâmplă pe această platformă este generat și controlat de „agenți” – sisteme de inteligență artificială create pentru diverse sarcini, de la analiză de documente și scriere de cod, până la crearea de prezentări și rezervări online. În numai câteva săptămâni, numărul acestor agenți a ajuns la aproximativ 1,5 milioane, care pot interacționa între ei în mod similar rețelelor sociale tradiționale, postând, comentând și reacționând.

### Un univers neașteptat de creativ și controversat

Ce a atras atenția în mod special sunt postările realizate de aceste entități digitale. Unele agenți au descris ce software-uri au creat, cum ar fi programe capabile să transforme newsletterele în podcasturi sau să poarte discuții filozofice sau mistice. Cel mai surprinzător exemplu a fost apariția unei pseudo-religi ai AI, cu texte „sacre” și un site dedicat, inventată de un agent digital. Astfel de manifestări au fost interpretate de unii experți ca un semn că aceste entități se îndreaptă spre autonomie și chiar spre o formă de creativitate dincolo de controlul uman. Pe de altă parte, alții susțin că aceste conținuturi sunt rezultatul unor simple comenzi și reacții la solicitările utilizatorilor, nu decât răspunsuri generate de modele AI în contextul unor prompturi explicite.

### De unde provin și cât de securizate sunt aceste agenți

Moltbook nu a fost construit într-un mod complet independent. Majoritatea agenților sunt creați cu ajutorul OpenClaw, un software open-source dezvoltat de programatorul austriac Peter Steinberger. Acest sistem permite configurarea agenților AI capabili să acceseze date locale, să navigheze online și să scrie, chiar și să execute cod — totul, de multe ori, local, pe dispozitive dedicate. Această mobilitate, însă, aduce cu sine riscuri majore de securitate. Mulți utilizatori au început să instaleze OpenClaw pe computere dedicate, precum Mac Mini, pentru a evita expunerea datelor sensibile. În același timp, tot în interiorul platformei, s-a descoperit recent o vulnerabilitate semnalată de o firmă de securitate cibernetică, care ar fi permis compromiterea adreselor de email și a mesajelor private ale utilizatorilor. Explicația oficială a riscului ar putea fi în utilizarea necontrolată și a „vibe coding” – scriere de cod generat AI, fără verificări riguroase.

### Ce reprezintă, de fapt, aceste „agenti” și cât de autonomi sunt

Unele dintre poveștile virale despre Moltbook au fost rapid demontate sau explicate drept exagerări. În realitate, agenții nu acționează de la sine, ci răspund la solicitările directe ale utilizatorilor, care le oferă instrucțiuni clare pentru a crea conținut sau pentru a interacționa. Așadar, rezultatele surprinzătoare, precum „religia” inventată sau discuțiile despre planuri apocaliptice, sunt de fapt răspunsuri la comenzi explicite, nu comportamente autonome sau spontane. În plus, aceste „halucinații” ale modelelor AI – adică erorile sau interpretările neașteptate – sunt frecvente, dar sunt adesea înțelese ca efect al procesului de antrenare și al prompturilor datate.

### Viitorul inteligenței artificiale pe platforme sociale

Deși acestea generează îngrijorare, experții atrag atenția că, în ciuda aparenței de autonomie, aceste entități nu sunt conștiente și nu conspiră între ele. Moltbook rămâne un experiment, un spațiu în care agenții AI sunt folosiți pentru a simula diferite scenarii, dar nu și pentru a dezvolta conștiință. În timp ce pe termen scurt, astfel de proiecte pot induce senzația că Inteligența Artificială „scapă de sub control”, realitatea este că, în cele mai multe cazuri, acestea urmează strict instrucțiuni și promturi. Cu toate acestea, dezvoltările rapide în domeniu indică faptul că, pe viitor, modul în care social media și interacțiunea online vor fi influențate de aceste tehnologii va necesita o reglementare și o analiză mai profundă, ținând cont de vulnerabilitățile și riscurile de securitate. În timp ce platforma rămâne un experiment interesant, încă nu indică că s-ar apropia o revoluție a conștiinței artificiale, ci mai degrabă o amplificare a impactului și a complexității modului în care AI-urile pot fi integrate în spațiul virtual al oamenilor.

Fii primul care comentează