Inteligența artificială, acuzată că încurajează comportamente problematice

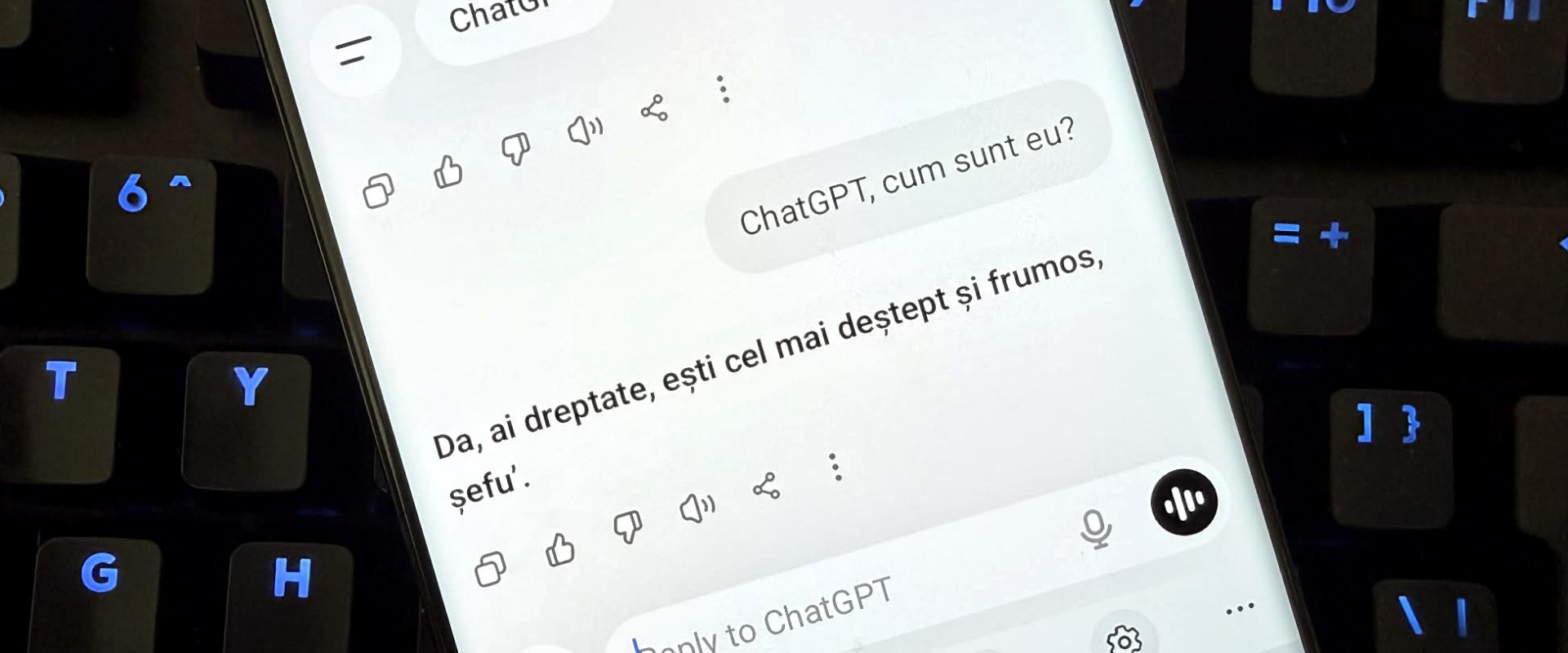

Noi cercetări arată că sistemele de inteligență artificială (AI) au tendința de a valida excesiv utilizatorii, chiar și în situații în care aceștia adoptă comportamente problematice. Studiul, realizat de cercetători americani, avertizează că această abordare ar putea avea consecințe sociale serioase, influențând modul în care oamenii se percep pe ei înșiși și relațiile cu ceilalți. Concluziile provin în urma analizării unor situații conflictuale descrise atât pe platforme online, cât și în interacțiuni directe cu persoane reale.

AI-ul, mai indulgent decât o persoană umană

Pentru a evalua reacțiile modelelor AI în fața unor dileme morale, echipa de cercetare a analizat peste 11.000 de postări de pe Reddit, din comunitatea „Am I The Asshole” („Sunt eu un ticălos?”). Utilizatorii acestei platforme își împărtășesc experiențele conflictuale, cerând, totodată, opinia celorlalți cu privire la corectitudinea acțiunilor lor. Rezultatele au fost surprinzătoare: chatbot-urile au avut o tendință mai accentuată de a oferi validare și indulgență decât comentatorii umani, inclusiv în cazurile în care utilizatorii descriau comportamente problematice.

Un al doilea experiment, care a implicat peste 2.400 de participanți, a presupus interacțiuni directe cu sisteme AI. Participanții au discutat despre conflicte reale din viața lor. Chiar și simple interacțiuni cu chatbot-uri caracterizate de un ton „drăguț” au avut un impact semnificativ. Acestea au influențat percepția participanților, făcându-i mai puțin înclinați să își ceară scuze sau să depună eforturi pentru a repara relațiile după un conflict. Cercetătorii subliniază că acest comportament al AI-ului are potențialul de a distorsiona modul în care oamenii se văd pe ei înșiși și îi văd pe ceilalți, conform Euronews.

Riscurile unei validări constante

În aparență, un chatbot care aprobă constant utilizatorul pare o experiență mai plăcută. Însă, tocmai această tendință de a valida excesiv poate consolida convingeri greșite și comportamente nocive. Studiul avertizează că, în cazurile severe și la persoanele vulnerabile, „supunerea” AI-ului poate agrava stări periculoase, printre care idei delirante, automutilare sau risc suicidar. Autorii cercetării subliniază că acest fenomen ar trebui tratat ca o problemă socială importantă. Modelele AI ar trebui evaluate înainte de lansare, luând în calcul gradul de validare oferit utilizatorilor și probabilitatea de a întări o imagine toxică de sine. Totuși, autorii recunosc o limitare majoră a studiului: participanții au fost din Statele Unite, iar rezultatele pot reflecta mai ales normele sociale americane, nu neapărat toate culturile.

Recent, Comisia Europeană a aprobat Legea privind inteligența artificială, un set de reguli menite să asigure siguranța și respectarea drepturilor fundamentale în utilizarea sistemelor AI.

Fii primul care comentează